- 目次

グローバルでのAI規制は「禁止」ではなく「統制された活用」

「現在のAIは、司法試験レベルの難問を突破したり、社員一人ひとりが簡単に業務に使えたりと、すでに人の能力に迫っています。これはビジネスチャンスが爆発的に広がったということです」と語るのは、NTTデータグループ グローバルガバナンス本部でAIガバナンスを所掌する伏田享平だ。一方で、AIの急激な進化はリスクも拡大させている。そこで、NTTデータグループが掲げるのが、「積極的なAI活用の推進とAIガバナンスの徹底を両輪とした支援」だ。特に本稿では、企業が取るべきAIガバナンスについて論じていく。

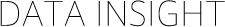

まず押さえておくべきは、グローバルの潮流だ。日本では、2025年12月に人工知能基本計画が閣議決定された。特徴は、企業の自主性を尊重するソフトローが中心である点だ。過度な規制を避けつつ、国際競争力と技術革新を重視している。

アメリカでは、大統領令により、AI規制について、連邦として統一的な基準を策定する方向性が示された。連邦政府の方針と異なる州のAI規制に対しては、法的措置を含めた対応も示されており、州独自規制の動きをけん制する狙いがある。

EUでは『AI Act』の施行が進む一方で、2025年11月には欧州委員会が、企業のAI導入に伴う負荷を軽減しイノベーションの促進を目的としたデジタル・オムニバス法案を提案。AI規制だけでなく、データやプライバシーなど複数のデジタル法制をまとめて整理し、簡素化する方向に向かっている。

図1:グローバルAI規制動向

EUのAI規制では、サプライチェーン内の全ての企業が対象となる

では、企業は各国の統制をどう読み解いて、AIを活用すればよいのか。伏田は最も厳格なEUのAI Actを例に取り「EU AI Actで特に理解していただきたいのは、これが『AIという技術そのもの』を一律に規制する法律ではないという点です。規制の対象となるのは『ユースケース』、つまり『何のために、どう使うか』です」と話を進めてこう続けた。

「例えば、生成AIの使用が社内文書の要約か与信判断かでは、リスクの扱いは全く異なります。この生成AIは安全なのかを見極めるだけでなく、この使い方は許容されるのかを問うのがEU AI Actの本質なのです」(伏田)

EU AI Actでは、4段階に分けてリスクを分類している。最上位は「受容できないAI」で人権侵害や社会的スコアリングなどが該当する。これは原則として使用禁止だ。次に「ハイリスクAI」。人の生命・権利・財産に影響を与えるもので、使用には厳格な適合性評価が求められる。その下に、AIシステム利用を明示する「透明性義務を伴うAI」が続き、最後に使用に特段の規制がない「極小リスクAI」がある。

ここで見落としてはならないのが、対象はEU域内の企業だけでないということだ。伏田は、「EUのマーケット向けにAIサービスを提供する場合や、EU域内の人に影響を与えるようなAIを使う場合も対象になります。企業がどこの国にあるかは関係ありません。日本企業であっても、EU向けのビジネスを行っていれば、この法律の対象になります」と強調する。

対象になる企業は、AIを開発・提供するプロバイダーだけではない。例えばハイリスクAIを運用する場合には、人による確認・判断を前提に運用すること、利用目的や影響を把握した上で使用することが求められるのだ。さらには、EU内にAIシステムを輸入・販売するインポーター、再販・流通させるディストリビューターも対象となっている。

日本のAI政策においても、活用推進とガバナンスはセットで捉えられている。人工知能基本計画には、「AIガバナンスの主導」(AIの信頼性を高める)という基本方針があり、「事業者等によるAIの研究及び開発・利活用における適正性の確保に向けた自主的な取組を促す」と記載されている。日本においても、ガバナンスは任意の取り組みではなく、社会的な責務として位置づけられつつあるのだ。

国内外の潮流からも、AIガバナンスは企業の重要な役割となりつつある。そして、AIをビジネス機会の創出と社会的要請の双方を満たしながら運用するには、新たなガバナンスの枠組みが必要だ。その枠組みを支えるのが、「ルール」、「教育」、「仕組み・体制」の3つをセットで回すこと。「ガバナンスがあるからこそ、現場は安心してAIビジネスに挑戦できるし、ビジネスチャンスを捕まえに行くことができます」(伏田)

実際に発生したAIによるリスクの具体例

では、このAIガバナンスをどのようにして実装するのか。NTTデータ サイバーセキュリティ統括部長の星野亮は、「AIガバナンスはブレーキではありません。むしろ、コントロールするためのハンドルという位置づけが分かりやすいと思います」と切り出し、AIリスクの具体像と、それに対する実装レベルの対策へと話を移す。

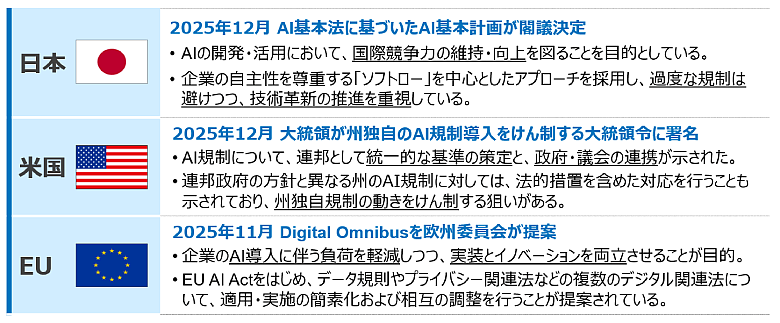

AI特有のリスクとして挙げられるのは、機密情報の漏えい、意図しない差別、不適切な判定、不正目的利用、ハルシネーションのような虚偽情報の出力などだ。星野は、「従来のITセキュリティの枠を超えた、より社会的な視点が必要です。公共性やプライバシー、倫理的な話も踏まえて考えなければなりません」と語る。その上で、企業がAIを活用するときのリスクを、「従業員のAI利用におけるリスク」と「顧客向けAIサービス提供におけるリスク」の2つに大別した。

図2:AI活用シーンに存在するさまざまなリスク

「従業員のAI利用におけるリスク」では、まず、誤情報を用いた業務遂行による品質低下が挙げられる。ここでは、誤った情報で作られた資料や判断が業務に混入する点が問題となる。また、機密情報・個人情報の漏えいやAIサービスの障害による業務影響も考えられる。さらに星野は「野良AIサービス利用のまん延が企業のITガバナンス崩壊につながる」と指摘する。

「新たなAIサービスが開発されて便利になるのはよいのですが、なかには、会社が許可していない安全性の低いAIサービス(野良AI)を個人的に使う社員もいます。これはガバナンスが崩壊している典型です」(星野)

「顧客向けAIサービス提供におけるリスク」では、誤情報の提示によって顧客に損害が生じ、訴訟へとつながる恐れがあったり、障害による事業継続性のリスクがあったりする。また、外部に提供するAIサービスで障害が起きると、大きな問題へと発展する。また、顧客データの不適切利用によるプライバシー侵害、外部からのサイバー攻撃、差別的な返信などの不適切な結果出力による企業のレピュテーション低下などが考えられる。いずれも、一度発生すれば経営に直結するものだ。

例えば、カナダの航空会社では、顧客向けの生成AIチャットボットが払い戻しルールについて誤った情報を提供し、乗客が払戻を請求する裁判で企業側が敗訴した。「AIの発言であろうとも、事業として提供している側の企業に責任がある」と判断された象徴的な事例だ。

ほかにも、AIサービスにおけるリスクは現実となっている。例えば、AIを悪用したサイバー攻撃によるセキュリティインシデントだ。生成AIを使ったランサムウェアの自作で国内初の摘発事例もあり、星野は「ランサムウェアの開発は高度な専門知識が必要でしたが、生成AIにより誰でもできるようになってきています」と警鐘を鳴らす。まだ実害は出ていないが、概念実証においてはAI駆動型ランサムウェアが、偵察から機密情報せっ取・暗号化までの各フェーズを自律的に遂行しているという。また、身近な犯罪では、ディープフェイクを使った詐欺被害や合成音声による詐欺被害も増加している。

「AIサービスそのものが攻撃対象になることもあります。いわゆる『プロンプトインジェクション』では、入力文を悪意的に工夫し、本来守られるべき指示や制約を上書き・回避させます。これを悪用されると、公開サービスで非公開の動作ルールや内部情報が出力される恐れがあり、サービス内部仕様や動作基準などの機密情報漏えいにつながります」(星野)

こうした事例を踏まえ、星野は「セキュリティのパラダイムシフト」を指摘する。従来のセキュリティは、境界型やゼロトラストの考え方に基づき、ITシステムの境界を守ることが中心。セキュリティの本質は、想定する脅威は主に外部からの攻撃者であり、不正侵入を防ぐことやシステムを正常に動作させることにあった。

「これからは、脅威は外部だけでなくAIモデル内部の論理や意思決定プロセスにも存在するのです。AIでは、守る対象も脅威の性質も変わります。AIはコードを実行するだけでなく、解釈・判断・生成・行動を行う存在。それ故、リスクは入力・出力・学習データ・プロンプト・モデル挙動の変化に潜んでいます。ハルシネーションや意図せぬ挙動が、システム障害や情報漏えいと同等のリスクとなります」(星野)

統制、評価・堅牢化、監視・保護でAIリスクに備える

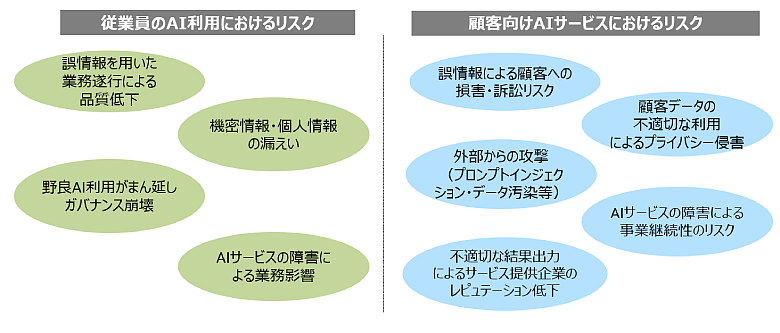

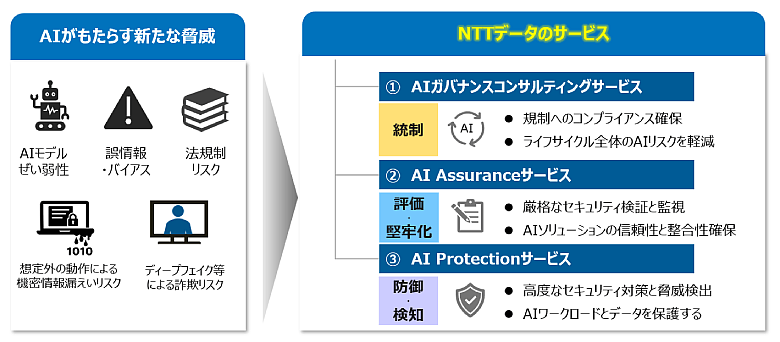

これらのリスクに企業はどう対応すべきか。星野は「統制」「評価・堅牢化」「防御・検知」からなる3つのステップを示す。

図3:AI活用シーンに存在するさまざまなリスク

「統制は、ルールやガイドラインを整え、それを回す体制を作ること。評価・堅牢化は、導入前にしっかりと評価し、問題があれば設計時点で直すのか、運用で担保するのかを決めておく。そして監視は、AI活用を始めた後に問題が起これば検知・対処し、ルールや仕組みを改善して回し続ける仕組みです」(星野)

これらのリスクと対策ステップを踏まえて、NTTデータはリスクに対してトータルでサポートしている。「統制」「評価・堅牢化」「防御・検知」までを一貫して支援し、企業のAI活用とAI提供、両面の安全性と信頼性確保を支援するソリューションである。

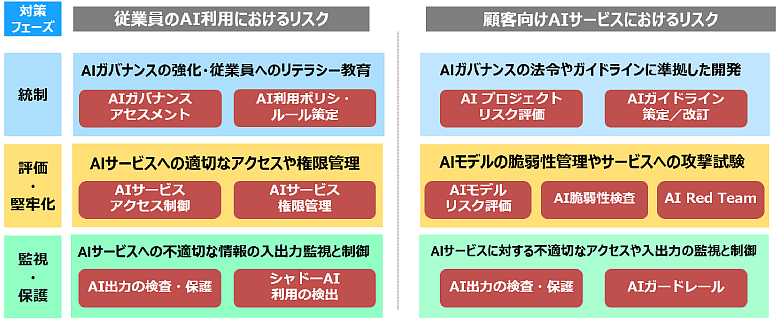

図4:NTTデータのサービス

「統制」にあたるのは、『AIガバナンスコンサルティングサービス』。AIプロジェクト単位で潜在リスクを評価し、必要な対策実行まで支援する。会社・組織としての体制づくり、プロセスづくりのほか、既存ルールのブラッシュアップや、未整備の場合は一からの策定も含む。

「評価・堅牢化」にあたる『AI Assuranceサービス』は、AIモデル単体の評価と、AIモデルを含むシステム全体の評価の2つの軸で構成される。モデル単体では、候補モデルの応答特性の比較評価を行い、どのモデルを選ぶべきかの判断を支援する。システム全体では、認証・認可、データ管理、ぜい弱性管理、ネットワークまで含めた安全性評価やぜい弱性診断を、さまざまなAIセイフティ・セキュリティのフレームワークに基づいて評価する。

「防御・検知」にあたる『AI Protectionサービス』で中心に据えるのは「AIガードレール」である。社員のAI利用を守る側面と、外部の攻撃からAIシステムを守る側面の双方をカバーする。倫理的・法的に不適切な応答や有害情報から社員を保護し、プロンプトインジェクションなどの悪意あるサイバー攻撃からAIシステムを防御する。

これらの取り組みにおけるNTTデータの強みは、3つ。1つは「自社グループ内でAI活用におけるガバナンスの課題に向き合い、対策を実践してきた経験と知見」、次に「コンサルから評価・対策の設計、監視・検知を含む運用まで、トータルで提供できること」、最後に「ネットワークやクラウドなどの基盤テクノロジーも含めた、AIサービスの実装に必要な全レイヤーのカバレッジ」だ。

NTTデータの役割は、顧客がAIによる価値創出を実現するために、安全で持続可能なイノベーションを通じて貢献していくことだ。最後に星野は、「AIを使うのは簡単です。しかし、責任を持って安全に使い続けることは、簡単ではありません。その部分をNTTデータがしっかりとサポートしていきます」と力を込めた。

- 能動的サイバー防御時代のセキュリティ人材育成

- 生成AI活用の新常識:AIのセキュリティリスクから企業を守る「ガードレール」とは

- 生成AIのリスクを可視化する「AIレッドチーム」

- りそなホールディングスと共創する、AIガバナンス構築の取り組み