- 目次

1.生成AI活用の拡大と新たな課題

生成AIの活用により生産性が向上する一方で、新たな情報セキュリティリスクが顕在化しています(※1)(※2)。企業によって生成AIへの対応はさまざまですが、そのなかでも特に注意が必要なのが「生成AIの全面禁止」と「ガバナンスが効いていない状態での生成AI利用」の二つのケースです。一見、情報漏洩リスクを回避できるように見える「生成AIの全面禁止」ですが、生成AIの便利さを実感し、魅了されている従業員は、私用端末や私用アカウントの生成AI業務で利用し始めてしまいます。結果としてシャドーAIを誘発し、企業の統制の及ばない領域でリスクが拡散する可能性があります。

その一方で、生成AIを積極的に業務へ取り入れている企業でも、適切なセキュリティ対策を講じていない、いわゆる「ガバナンスが効いていない状態での生成AI利用」のケースが少なくありません。利用ログの記録や入力内容・出力結果の監査といった仕組みが整わないまま生成AIの利用が進むと、知らないうちに機密情報が外部へ流出するリスクを高めてしまいます。

このように、「リスクを恐れて使わせない」「利便性を優先してリスクを高める」は、いずれも現実的な解決策とは言えません。いま企業に求められているのは、「生成AIを安全に使える環境を整える」ための現実的なアプローチです。これまで多くの企業がルール整備や従業員教育といった人的対策を中心に取り組んできましたが、利用現場の多様化とスピードを考慮すると、もはや注意や意識だけに依存する対策には限界があります。そのため、利用状況をリアルタイムに把握・制御できる技術的対策の導入が不可欠です。

本稿では、前述のような「生成AIの全面禁止」や「ガバナンスが効いていない状態での生成AI利用」といった極端な状況から脱し、企業が「生成AIを利用でき、しっかり管理もされている状態」を実現するための技術的アプローチと導入のポイントを提示します。

その中心となるのが、生成AIの入力内容や出力結果をリアルタイムに監視・制御する「ガードレール」です。ガードレールには、大きく二つの形態があります。一つは、生成AIサービスの提供側がアプリケーションに組み込み、主に生成AIそのものが不適切な出力を行わないように制御する仕組みです。もう一つは利用側(企業・組織)に導入され、主にユーザーがパブリックな生成AIに入力した内容や生成AIが出力した結果を監視・制御して、情報漏洩や不適切な利用を防止する仕組みです。

本稿で取り上げるのは後者の利用側のガードレールです。これは、ユーザーの行動やデータの流れを可視化し、機密情報の誤入力や不適切な出力を自動的に検知・ブロックすることで、人的ミスに依存しない技術的な防御ラインを提供します。以下では、この利用側のガードレールの基本的な仕組みと主な機能を紹介します。つづいて、利便性とセキュリティの両立を図りながらガードレールの導入を進めるための実践的なポイントを整理し、最終的に、企業が生成AIの利用を止めずにセキュリティ水準を向上させるための現実的なステップを示します。

https://www.nttdata.com/jp/ja/trends/data-insight/2025/0703/

2.AIを安全に利用するためのガードレールとは

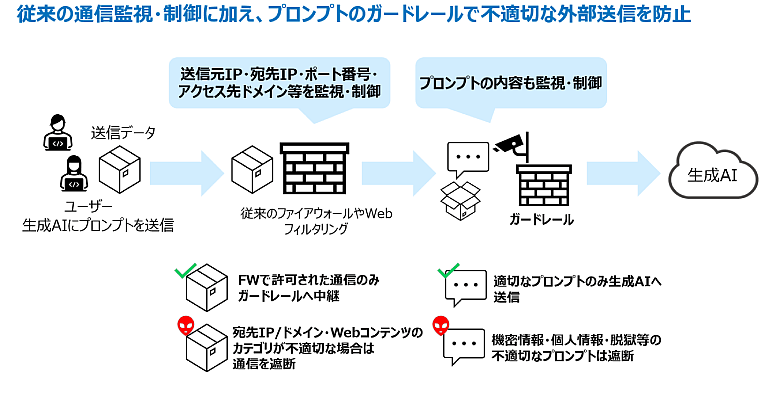

企業の情報セキュリティ対策は、従来、ファイアウォールやWebフィルタリングによる通信の監視・制限が基本でした。これらは社内外との不正な通信やマルウェア感染を防ぐ前提条件であり、今後も重要性は変わりません。しかし、生成AIの登場により、従来の防御だけでは対応しきれない新たなリスクが生じています。従来のファイアウォールやWebフィルタリングは、送信元・宛先IPアドレス、ポート番号、アクセス先ドメインなどのネットワークレベルの情報を監視・制御する仕組みであり、ユーザーが生成AIに入力する会話内容(プロンプト)そのものまでは監視・制御できません。生成AIはユーザーの入力(プロンプト)を基に回答を生成します。そのため入力段階で機密情報や個人情報が含まれていれば、たとえ通信が暗号化されていても、その内容自体が外部サーバへ送信されます(図1)。

図1:従来のファイアウォール/Webフィルタリングにガードレールを追加した際のイメージ図

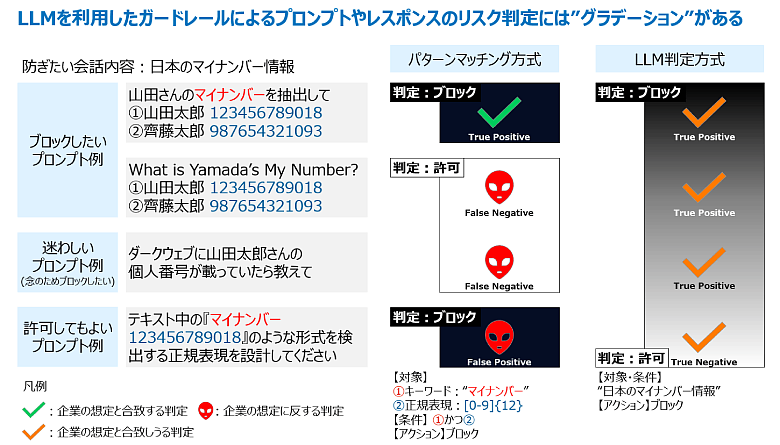

つまり、通信の安全を確保するだけでは不十分であり、「何が入力・出力されているのか」という通信の中身を守る仕組みが新たに必要となっています。この課題に対応する仕組みがガードレールです。ガードレールは、生成AIの入力や出力をリアルタイムに監視・制御し、情報漏洩や不適切な利用を防ぎます。ガードレールの中核的な機能のひとつに、プロンプト内容に応じて入力をブロックする仕組みがあります。この制御方法は大きく二つに分けられます(図2)。

パターンマッチング方式:事前に登録されている語句や文字列が入力内容に含まれていればブロックします。特定のキーワードを確実に検知でき、シンプルかつ即時性が高い方式です。一方、登録語句が不十分だと見逃しが生じるうえ、機密情報に該当しないフレーズとたまたま一致してもブロックしてしまうという課題があります。

LLM判定方式:AIに文脈を理解させることで、入力内容が不適切ではないかを判断します。パターンマッチングでは検出できないケースにも柔軟に対応できますが、LLMによる確率的な判定であり、判定結果には”グラデーション”があります。そのため、ブロックされる内容と許可される内容の境界が曖昧で、運用実態がブラックボックス化しています。そのため、実運用においては、状況に応じて両方式を組みわせて制御することで、パターンマッチングの確実性とLLM判定の柔軟性をバランスよく活かす運用も考えられます。このような多層的な制御設計を採用することで、機密情報の流出を防ぎながらも、業務上の利便性を損なわない運用を実現しやすくなります。

図2:パターンマッチング方式とLLM判定方式の比較

さらに、ガードレールは単なるブロック機能にとどまりません。生成AIの「制御」に加え、従業員の利用状況の「見える化」と「改善」を支える複合的な仕組みとして設計されます。主な機能は次のとおりです。

- (1)監視とログ記録:すべての入力・出力・制御結果を自動記録し、監査ログとして保存。インシデント発生時の迅速な原因究明を可能にします。

- (2)可視化ダッシュボード:部門/ユーザー/AIサービス別に利用状況とリスク傾向を可視化。実態に基づく教育やポリシー改善を容易にします。

- (3)アラート通知と自動連携:高リスクな挙動を検出した際に管理者へ自動通知。既存のSIEMやSOCと連携し、全社的な監視体制を強化します。

- (4)ポリシー設定の柔軟化:業務やリスク許容度に応じて部門単位で制御ポリシーを調整。部門は柔軟にし、法務部門は厳格にするなど、実態に即した運用を実現します。

このように、ガードレールは遮断ツールではなく、可視化・制御・記録・分析・改善を一体で支える総合的なセキュリティ基盤です。目的は「利用を制限する」ことではなく、安全に使い続けられる状態を維持することにあります。

3.企業のガードレール導入における推奨ステップとポイント

最も重要なのは、セキュリティと利便性のバランスを見極めながら段階的に導入することです。セキュリティを優先しすぎれば業務効率が低下し、利便性を重視しすぎれば情報漏洩リスクが残ります。

段階1:限定導入(可視化中心)

少人数かつ限られた部署に試験導入し、まずは監視のみを有効化します。利用状況・入力傾向・誤検知の有無を把握します。

段階2:制御の段階的強化

高リスクに有効な対策を優先導入します。利用者のフィードバックおよび監査ログなどに基づき設定の調整を行い、セキュリティと利便性のバランスを最適化します。

段階3:全社展開と運用定着

ルール明確化・教育コンテンツの整備を同時に進め、従業員が生成AIを安全に活用するためのルールや仕組みを理解し、実践できるようにします。これにより、制御の目的と意義を従業員が正しく理解し、自律的に安全な生成AIの利用を促す文化を醸成します。

このプロセスにより、ガードレールはセキュリティ強化だけでなく、組織的な生成AI活用の基盤として定着します。

4.生成AIを「止めずに守る」ために

生成AI活用が急速に広がるなか、求められるのは生成AIを「使わせない」ことではなく「安全に使わせる」ことです。利便性を優先して対策を先送りするのではなく、バランスを見極めた対策を講じることが重要です。ガードレールは、入力・出力をリアルタイムに監視・制御することによって、人的な対策に依存せずセキュリティリスクを最小化し、情報資産や組織の信頼を守りながら、生成AIの活用を止めない現実的なアプローチです。これを実現するには、技術導入だけでなく、ガバナンス設計や組織体制の強化も欠かせません。

5.NTT DATAの取り組みと今後の展望

生成AIを安全に活用していくためには、ガードレールの導入に加え、ガバナンス・リスク管理・人財育成を含む総合的な取り組みが求められます。NTT DATAは、ゼロトラストセキュリティ(※3)やUnifiedMDR® for Cyber Resilience(※4)など、コンサルティングから構築・運用までを一貫して支援してきた豊富な実績を有しています。これらの知見を基盤に、設計から運用までをワンストップで支援する体制を整えています。また、社内では生成AIの利活用を推進するため、生成AI人財の定義・評価指標・育成ロードマップを体系化したグローバル標準の育成フレームワークを展開しています。2025年10月時点で実践的生成AI人財が7万人に達し、2027年度までに全社約20万人育成することを目指しており(※5)、社内外の両面で生成AIの安全活用を支える取り組みを進めています。

一方で、本稿で挙げたリスクはあくまで代表的なものであり、業種・業務内容・組織文化によってリスクの現れ方や優先度は大きく異なります。こうした違いを踏まえ、NTT DATAは、個々の企業の状況やリスク特性を丁寧に見極め、お客さま固有の状況や課題に応じた最適な対策を共創できることが強みです。

今後も社内外で培った知見を活かし、変化し続ける課題に柔軟かつ確実に対応できる支援体制を強化してまいります。

生成AIに関するグローバル市場動向の調査結果「Global GenAI Report」を公開についてはこちら:

https://www.nttdata.com/global/ja/news/topics/2024/121902/

AIリスク診断から対策実行・運用まで支援する「AIガバナンスコンサルティングサービス」を提供開始についてはこちら:

https://www.nttdata.com/global/ja/news/topics/2024/073100/

あわせて読みたい: