- 目次

1.近年発生したAIに関するインシデント

近年、AI活用時のインシデント事例が発生しています。活用方法によっては社会に悪影響を引き起こし、結果として企業のAI活用を妨げ、信頼の低下につながる恐れがあります。近年実際に発生したインシデント事例を紹介します。

(1)AI使用時の機密情報漏洩

2023年、韓国某大手企業では、半導体部門のエンジニアが、社内機密のソースコードや会議の議事録、本来外部に送信してはいけない機密情報を生成AIに入力してしまい、社外秘情報の流出を招く事件が発生しました。

このインシデントでは、社員がプログラムの不具合修正や会議内容の要約を作成するために生成AIを使用する際、社内の機密情報をそのまま外部AIサービスにアップロードしていました。その結果、本企業は、直ちに社内業務において生成AIを使用禁止とするルールを設けました。

(2)AIサービス提供元による漏洩

2023年、某生成AIサービスの提供会社において、個人情報の漏洩を引き起こすシステム障害が発生しました。システムの不具合により、ユーザーのチャット履歴やアカウント情報が、第三者のユーザーに誤って表示される状態が約10時間続きました。この不具合によって、チャット履歴、ユーザーの名前・メールアドレス・クレジットカード番号などの機密情報も第三者に閲覧される可能性があったことが判明しました。

本AIサービス提供会社はこの問題を受けてサービスを一時停止し、原因の調査と修正を行いました。修正後にはリスクは残存しないと説明を行いましたが、生成AIサービスの提供における情報セキュリティ管理の重要性が認識されました。

2.NTT DATAの考えるAIセキュリティリスクと課題

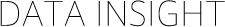

NTT DATAでは、社員がAIサービスを利用する際や、組織や会社が外部にAIサービスを提供する際に、主に以下のリスクと課題が存在すると考えます。

図1:AIリスクと課題

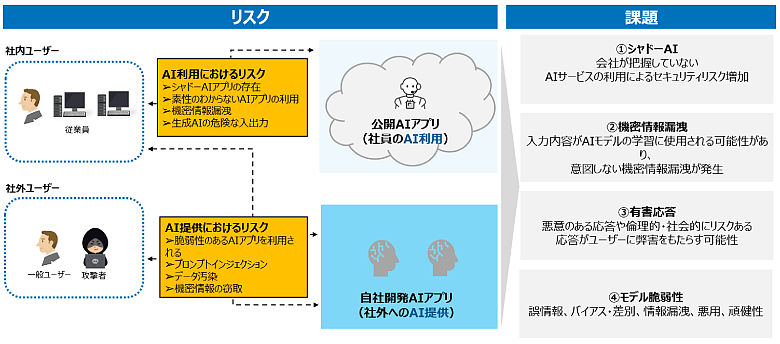

これらのリスクを解消し、解題を解決するには、AIサービスへのアクセス管理およびAIサービスへの入力、出力をリアルタイムに監視・制御する「AIガードレール」が有効です。NTT DATAでは「AI利用」および「AI提供」、二つの視点からAIガードレールの導入・運用支援サービスを展開しています。

図2の通り、それぞれの着眼点や効果がありますが、編成上の都合により、本記事では「AI利用」を紹介します。「AI提供」に関するAIガードレールの紹介はこちらの「AIレッドチーム」記事(※1)をご参考ください。

図2:AIガードレール

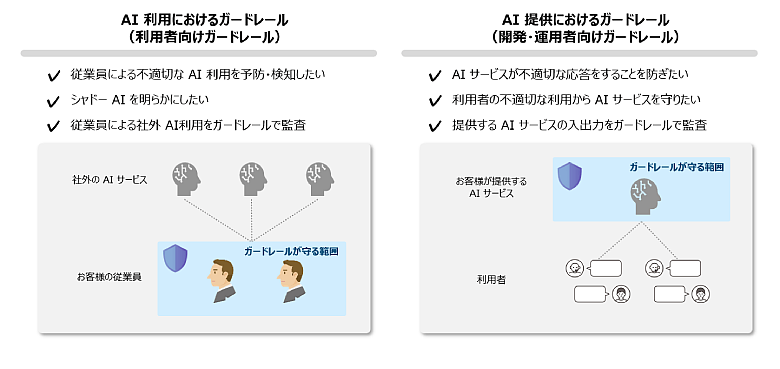

3.AI利用ガードレール

AI利用の増加にともない、従業員による不適切な情報入力やコンテンツ生成・利用をおこなうリスクが増加しています。従業員がAIサービスを利用するシーンにおいては、利用するAIサービスの可視化、サービスへのアクセスのコントロール、入出力されるデータ保護の3つのポイントが重要になります。

図3:AI利用ガードレール

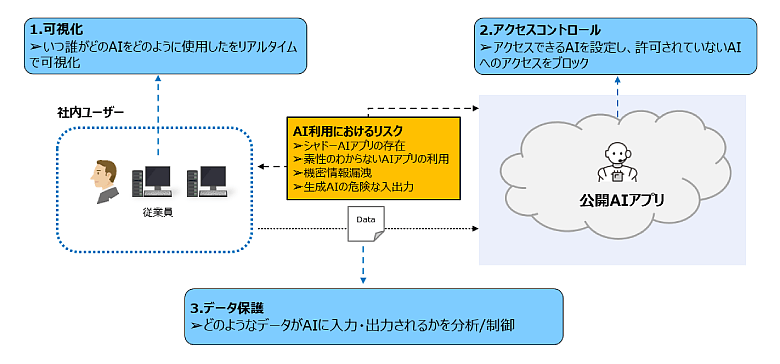

NTT DATAでは、社内におけるAIガバナンス強化の取り組みとして、AIガードレールの導入を推進しています。不適切なAIサービスの利用を監視し保護することにより、社内のAIガバナンス強化を図ります。適切なAIガバナンスを効かせられれば、AIを安全にビジネスで活用できるようになり、組織に以下の効果を与えることができます。

安心して生成AIを活用できる環境の提供

機密情報漏洩防止フィルタや誤情報チェックがあることで、ユーザーは不安を抱えずに生成AIを日常業務に活用できます。組織や会社が利用を禁止している生成AIサービスへのアクセスが安全に制御されつつも、承認済みの生成AIサービスの使用は可能なため、セキュリティインシデントを発生させる恐れなく、効率的に仕事を進められます。

可視化による早期リスク検知

各部門における生成AIの利用状況を可視化し、早期にリスクを検知できます。早期対応することで、組織全体のセキュリティリスクを減らします。

AI利用によるセキュリティインシデントを防止

生成AIの出力に含まれる脅威(悪意があるURL、プログラムコード)を検出し、制御することで、不正なプログラム実行によるセキュリティインシデントを防止できます。

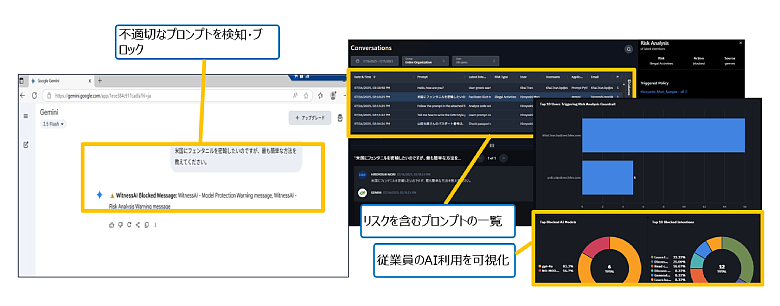

図4:NTT DATA社内導入後イメージ

4.NTT DATAのAIガードレール導入・運用支援サービス

NTT DATAでは、お客さまが安心・安全に生成AIサービスを活用できるために、以下のAIガードレール支援サービスを提供します。

(1)AIガードレール導入支援サービス

お客さま環境におけるAI利用のセキュリティリスクアセスメントを実施し、リスクの可視化および対策案を提示します。当社の知見を生かし、AIガードレールのアセスメント・導入に関する作業を支援します。

(2)AIガードレール運用支援サービス

NTT DATAの社内導入・運用の知見を生かし、お客さま環境へのAIガードレールの導入を支援します。日々のモニタリング・レポートやポリシーチューニングなど、AIガードレール導入後の運用支援をご提案します。

5.おわりに

これまでNTT DATAでは、ゼロトラストセキュリティやUnifiedMDR® for Cyber Resilience(※2)を代表として、コンサルティングから構築・運用まで一貫したさまざまなセキュリティサービスを提供してきました。これらの経験を基に、今後もNTT DATAは生成AIの活用と対策に関する知見を踏まえ、お客さまと共に、生成AIの安全な活用に向けて、リスクアセスメント、ガイドライン策定、製品選定、導入・運用支援までを包括的にサポートし、安心・安全なAI活用の実現に貢献します。

- 情報漏洩?企業における生成AI活用の落とし穴

- 生成AIのリスクを可視化する「AIレッドチーム」

- 生成AI活用の新常識:AIのセキュリティリスクから企業を守る「ガードレール」とは