- 目次

なぜ「正しいAI」でも社会に受け入れられないのか

生成AIやAIエージェントの進展により、企業におけるAI活用は急速に拡大しています。採用、顧客対応、マーケティングなど、意思決定の現場にAIが組み込まれることはもはや特別なことではありません。

一方で、AI活用に伴うトラブルや炎上事例も増加しています。たとえば、採用・人事領域におけるAI評価の導入が「何を根拠に判断しているのか分からない」という不信を招いてしまう場合や、顧客データを活用した高度なパーソナライズ施策が、利便性の提供としてではなく過剰な追跡や操作として受け止められ批判される場合などがあります。

興味深いのは、これらの多くが必ずしも法令違反ではないにもかかわらず発生している点です。同様の技術を用いていても、あるケースでは受け入れられ、別のケースでは強い反発を招く、といったことが見受けられます。この違いはどこから生まれるのでしょうか。ここに単なる「技術の問題」では説明できない、新たな論点が浮上しています。

まずAI活用においては、これまで「透明性を確保し、十分に情報開示を行えばよい」という考え方が広く共有されてきました。実際、各種ガイドラインや法制度においても、透明性や説明責任の重要性が繰り返し指摘されています。

しかし、その前提自体を見直す必要が出てきています。

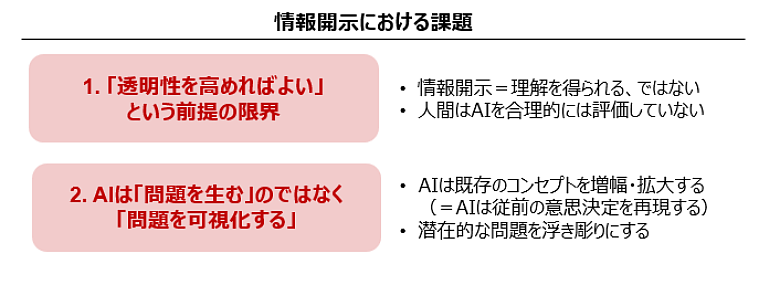

図1:情報開示における課題

「透明性を高めればよい」という前提の限界

第一に、情報を開示すれば理解されるとは限らないという点です。AIの学習データやアルゴリズムの詳細を提示しても、多くの利用者にとっては解釈が困難であり、納得感の向上には直結しません。一方で、理解しやすさを優先した簡潔な情報開示のみでは詳細が伝えきれず、専門的知識を有する人々からの理解を得ることが困難です。

また議論においては、人間は合理性だけでAIを評価しているわけではない点も指摘されました。AI活用における人間の関与の有無、企業による努力の可視性といった要素が受容性を大きく左右することが、社会学的実験においても明らかになっています。特にAIを活用せずとも人間でもできることをAIに代替することで、「AIを使って楽をしている」という印象を与えてしまうことはネガティブに働きます。

AIは「問題を生む」のではなく「問題を可視化する」

第二に、開示そのものが新たなリスクを生む可能性です。人間の判断では曖昧に処理されてきた意思決定基準が、AIによって形式化・可視化されることで、かえって不公平性やバイアスが顕在化する場合があります。つまり、「何を開示するか」という観点だけでは不十分であり、AI活用における本質的な課題は別のところにあると考えられます。

つまり、AIは意思決定そのものを変えるのではなく、既存のコンセプトや判断基準を増幅する存在であるということです。採用や評価といった業務においてコンセプト(目標・方針・判断基準等)の設計が曖昧であれば、その曖昧さがAIによって拡大され、問題として顕在化します。これによって人間の判断では見えなかった、または無意識的に隠されていたバイアスや不公平が、AIによって明示化されることで、初めて問題として認識されます。すなわち、AIは新たな問題を生み出しているのではなく、既存の問題を「可視化」しているのだと言えます。

「情報開示」から「メッセージ設計」への転換

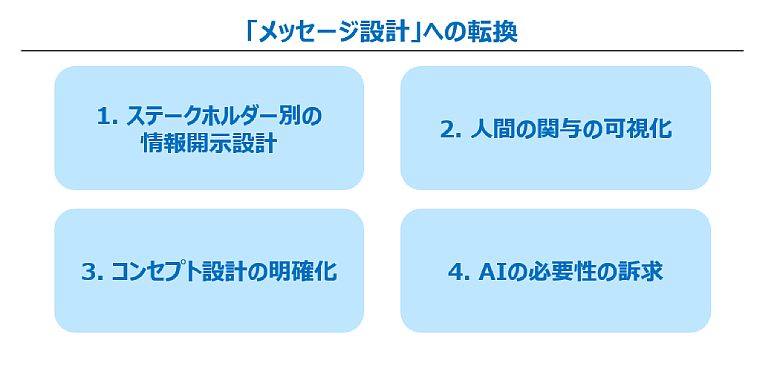

以上の課題を克服するべく、企業に求められる対応は以下の点を重視した「メッセージ設計への転換」です。

図2:「メッセージ設計」への展開

第一に、ステークホルダー別の情報開示設計です。専門家、利用者、一般消費者といった対象ごとに、必要な情報の粒度や形式は異なります。技術的詳細だけでなく、利用目的や影響範囲を踏まえた説明の工夫が求められます。

第二に、人間の関与や努力の可視化です。従来人間が行ってきた一連の活動の全てを代替しているのではなく、最終判断における人間の役割を明示することで人間関与を示すこと、またAI活用に伴って企業側がどのような注意を払いどんな努力しているかを伝えることが重要です。

第三に、コンセプト設計の明確化です。AIは既存の意思決定ロジックを拡張するため、その前提となる評価基準や判断方針を言語化し、説明可能な形で設計することが不可欠となります。つまりAIが代替する人間の営みが、可能な限り合理的かつ説明可能なデザインにされていることが肝要です。

そして最後にAI活用の必要性の訴求です。最も重要なのは、AIを使う必然性や価値があること、例えばAIを活用することでこれまで人間ではできなかったことが実現できる、といった点を説明することです。これらを含めて設計されたコミュニケーションこそが、社会的受容性を左右すると言えます。

最後に:新たな技術の社会実装を目指して

AI活用が進むこれからの時代において、企業が向き合うべき課題は、単なる技術導入やルール遵守にとどまりません。AIは、これまで暗黙のうちに許容されてきた意思決定の曖昧さや不均一さを可視化し、企業に対してより高い説明責任を求める存在です。言い換えれば、AIの社会実装とは、技術の問題であると同時に、企業と社会の関係性そのものを問い直すプロセスでもあるのです。

だからこそ重要になるのは、「何を開示するか」ではなく、「どのように社会と向き合い、どのように伝えるか」という設計です。情報開示をメッセージの発信として捉え、ステークホルダーとの信頼関係を構築していくことが、AI時代における企業価値の基盤となり得ます。

NTT DATAは責任ある技術の社会実装に向けて、技術の可能性と社会の受容性を両立させるために、AIを超えたテクノロジーのガバナンスの高度化に挑み続けます。今後も安心安全なテクノロジーの社会実装に向けて、AIアドバイザリーボード総会における議論も含め、さまざまな形で社内外の知見を結集します。そして、実装と統制のバランスを追求することで、社会に信頼される技術活用を推進していきます。

AIガバナンスについてはこちら:

https://www.nttdata.com/jp/ja/services/data-and-intelligence/governance

AIエージェント(AI Agent)についてはこちら:

https://www.nttdata.com/jp/ja/services/generative-ai/ai-agent

あわせて読みたい: