1.序論

感情を伝える際、視覚情報が38%、聴覚情報が38%、言語情報が7%の割合で相手に影響を与えるというメラビアンの法則が示すように、表情や声のトーンといった非言語情報はコミュニケーションにおいて大きな役割を果たします。しかし現状の生成AIは入出力の多くがテキストベースであり、非言語的要素の処理はまだ発展途上です。そのためこの記事では、主に「言語情報」に焦点を絞り、人間らしい対話に向けた現実的な活用と今後の課題を明確にしていきます。

2.生成AIの評価指標と「人間らしさ」の再定義

生成AIの評価指標

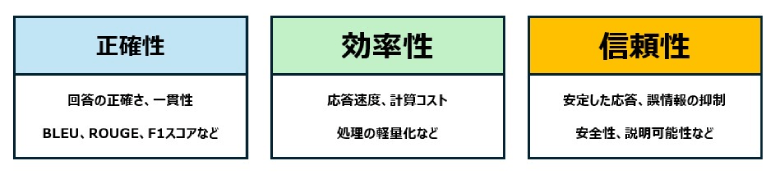

生成AIの性能は、これまで主に正確性・効率性・信頼性といった、客観的で測定可能な指標によって評価されてきました(図)。

まず「正確性(accuracy)」は、モデルが与えられた問いや文脈に対して、どれだけ正確な情報や一貫した出力を返せるかを示すものです。特に自然言語処理分野では、BLEUやROUGE、F1スコアなど、出力文と正解データの一致度を測る自動評価尺度が広く用いられてきました。次に「効率性(efficiency)」は、モデルの応答速度や計算コスト、消費リソースの最適化といった観点から測られます。大規模モデルの実用化が進むにつれ、処理の軽量化やエネルギー効率の向上が、社会的にも経済的にも重要な指標となっています。「信頼性(reliability)」は、AIが安定して再現性のある応答を生成できるか、あるいは誤情報・有害表現をどの程度抑制できるかという観点で評価されます。近年では、ファクトチェック精度や倫理的ガイドライン順守率など、安全性や説明可能性(explainability)を含めた多面的評価が重視されています。

図:生成AIの評価指標

しかし、生成AIが社会や人間と共に対話する存在へと進化する中で、共感や自然さ、文脈理解といった「人間らしさ」の評価は、従来の指標だけでは十分に測りきれません。GPT-5の登場時には「GPT-4のほうが温かみがある」と感じるユーザーも多く、生成AIにおける「人間らしさ」の重要性が再認識されました。(※)

実際、生成AIは大量の言語データから人間の対話パターンを学習し、文脈や感情に応じて自然かつ共感的な応答を生成する力を持っています。この特性を活かし、対話ロボットの分野でも、人間らしい対話や共感的なコミュニケーションを実現しようとする取り組みが進んでいます。例えば、ソフトバンクロボティクスでは、ChatGPTを連携した対話ロボット「Pepper」が、発話内容やトーンに合わせて共感的な返答を行う実験を行っており、生成AIがロボットに人間らしさを与える事例として注目されています。

こうした動向を踏まえると、生成AIの評価においては、単に「正しい答え」を導く能力だけでなく、「人間らしさ」を備えているかどうかも、これからの重要な指標となるでしょう。

人間らしい対話とは何か:内容と形式の二軸から

過去の多くの研究は「特定の機能ができれば人間らしさが高まる」とする機能的アプローチにとどまり、人間らしさを評価するための統一的な定義はいまだに存在していません。本稿では、複雑な心理学・哲学的議論を避け、言語情報の観点から「人間らしい対話」を支える要素として次の二軸で定義します。

内容(意味づくり):何をどのような意味で伝えるかという側面

- 関連性:相手の発言または発言に隠れた意図や感情(含意)を受けて、それに関連する内容を返す

- 一貫性:対話全体で矛盾がなく、ストーリーが通っている

形式(やりとりの構造):対話がどのように進むかという側面

- ターンテイキング:発話の交代が自然であること

- 修復機構:言い間違い・誤解を訂正・確認するプロセス

- 談話マーカー:「えっと」「そうですね」など会話を滑らかにする表現

- 非言語的要素:間、うなずき、視線など

この二つの要素は、人間の対話行動を構成する最小単位であり、どちらか一方では「人間らしさ」は成立しません。特にテキスト中心の生成AIでは、内容と形式の両立が人間らしさを最も端的に示す要素となります。

3.生成AIはどこまで「人間らしい対話」を再現できているのか

内容面:意味・文脈理解力の進化と限界

従来のルールベース型対話システムは想定外の質問に対応できず、対話が途切れやすいものでした。対して、生成AIは大規模言語モデル(LLM)によって膨大な文脈パターンを学習し、より自然な言語生成を実現しています。その中核が、文中の単語同士の関連度を計算し、重要な部分に注目して文脈を理解する仕組み、Transformer構造の自己注意機構(Self-Attention)です。

これにより、AIは発話全体の文脈を考慮し、一貫した内容を維持できるようになりました。ただし、人間のように「意図」や「感情」まで本質的に理解しているわけではありません。たとえば「今日は重い一日だった」という発言を「荷物が多かったのですか?」と解釈してしまうなど、比喩的・情緒的な意味の理解は依然として課題です。

形式面:やりとりの構造は不完全

一方で、相づち・修復・発話交代といった対話のリズムの再現は依然として難しい状況です。現在の生成AIはテキストを逐次処理しており、リアルタイムな相互作用やタイミング調整を直接モデル化していません。人間は相手の発話を聞きながら誤解を即座に察知し、自発的に修正しますが、AIの誤り訂正は外部から再入力された場合に限られます。また、人間の会話ではわずか0.2秒ほどで話者が入れ替わりますが、AIはその瞬間的な判断ができず、応答が間延びしたり、逆に不自然に整いすぎたりすることがあります。

4.人間らしい対話を実現するための要件

破綻検出と自己修復機構

現在の生成AIは一度出力を生成するとそれを完了とみなし、自ら修正することはありません。AIが自らの発話内容を監視し、曖昧さや矛盾を検知して修正する仕組み--すなわち自己修復機構が必要だと考えられます。確信度が下がった場合に自動的に再説明したり、ユーザーに確認を求めたりする機能が備われば、AIは誤りを含みながらも対話を続けられる存在となり、より自然な対話が可能になります。

対話モードの動的切り替え

人間の対話は、場面に応じて「やりとり」と「傾聴」を切り替えながら進行しますが、現状の生成AIは、状況や話題の性質にかかわらず常に同じ応答スタイルをとり、相手の語りへの没入や共感的傾聴が十分に行えていません。そこで、対話モードの切り替えをAIが自動的に行うことが求められます。ユーザーの語り口や発話量、感情トーンを検知し、共感的な相づちや沈黙を挟むなど、対話の重心を柔軟に調整できれば、AIは初めて相手に寄り添う対話者となれます。

リアルタイム処理の実現

上記で述べた二つの機能要件はいずれも、リアルタイムに機能することが前提となります。現在の生成AIは、入力が完了してから出力を生成するため、応答がわずかに遅れたり、対話が一拍止まったりすることが多く、発話を生成しながら同時に入力を処理する並行的な制御が求められます。これにより、相手の発話途中で曖昧さを検知して修正したり、聞き手モードへ自動的に移行したりといった応答を即座に行うことが可能となり、こうした精緻なタイミング制御こそが、自然な対話を支える重要な仕組みとなります。実際、こうした取り組みはすでに始まっており、例えばOpenAIの「リアルタイムAPI」は、AIがユーザーの音声や入力を受け取りながら、発話生成中に同時応答する仕組みを備えています。

5.応用領域

可視化されないコミュニケーション障害

人間らしい生成AIは、単なる質問応答システムではなく、現場の課題を可視化し改善へつなぐものであるべきです。特に、企業が抱えてきたコミュニケーション障害のリスクを軽減するうえで、その応用性は高いと言えます。コミュニケーション障害とは、「言いづらい」あるいは「言語化しにくい」ことで必要な情報や感情が相手に伝わらない状態を指し、業種や職種を問わず多くの企業に共通する課題です。こうした障害は情報の共有を妨げ、事故・不正・リコール・離職など、本来防げたはずの重大リスクの早期発見を難しくします。しかも、人間の努力だけで完全に解消するには限界があります。

「言いづらい」背景には、評価への不安、相手の忙しさへの遠慮、迷惑をかけたくないという心理、対立回避の傾向などがあります。また、上司や同僚との距離感や冷たそう・余裕がなさそうといった印象が相談行動をさらに阻害し、小さな違和感や不調が見過ごされやすくなります。一方、「言語化しにくい」課題も根深いです。感情や体調の変化は曖昧で、自身でも問題の輪郭を把握しづらいものです。また、経験不足や専門知識の欠如が状況説明を難しくし、「相談」という形にまとまらないまま周囲に気づかれず放置されてしまうことも多く見られます。

人間らしい生成AIの役割

一方で人間らしい生成AIは、この構造的制約を補完する形で機能します。ユーザーが安心・継続して話せる環境を提供するとともに、高度な対話技術を用いて曖昧な感情や状況を丁寧に受け止めながら本音を引き出します。また、質問・深掘り・整理のプロセスを通じて課題の核心を抽出し、判断可能な形式へと構造化します。これらのアプローチによって、複雑で曖昧な情報が業務改善に活用できる確かなデータへと変換されます。企業側は、AIが示した情報を基に、適切な担当へのルーティング基準を設け、改善施策の実行から結果のフィードバックまでを一連の流れとして運用していきます。こうした仕組みにより、「AIに言えば改善される」という文化が育ち、AIと組織が連携した持続的なコミュニケーション改善が可能になります。

現場での具体的応用

職場におけるコミュニケーション支援は、個人のスマートフォンで気軽に使える相談窓口としての提供から、業務フローに組み込まれた「気づきの対話トリガー」としての仕組みまで、多様な形で実装できます。例えば人事では、従業員が日常の雑談のようにAIと話す中で「最近しんどい」「仕事が合っているか不安」といった小さな兆しが自然に引き出され、離職予兆を早期に察知できます。医療現場では、「患者の様子が言葉にしにくい違和感として気になる」「薬の減り方が少し変」など、看護師が迷う微細な感覚をAIが対話の中で丁寧に拾い上げ、重大インシデントの初期兆候として共有できます。また、心理的負荷の高いスタッフが匿名でも安心して語れる支えとなります。金融では、「最近承認が雑な気がする」「説明が腑に落ちない」といった不正リスクの芽をコンプライアンス部門に安全に届けるルートとして機能します。製造では、作業者が「音がいつもと違う」「手順が微妙にやりづらい」といった曖昧な違和感をAIとの対話で言語化しやすくなり、ライン停止につながる前に異常兆候を把握できるほか、ヒヤリハットを日々吸い上げ、安全・品質トラブルを未然に防ぐ仕組みとして活用されます。このように、利用者が意識して報告しようとしなくても、自然なやりとりの中から重要な気づきが引き出される点が大きな価値です。

6.まとめ

人間らしい生成AIは、対話の質を高め、継続的な関係の構築や課題解決に貢献することで、人とAIが共生する社会の実現を支える存在となります。今後、より人間らしい対話体験を実現するためには、表情・音声・姿勢といったマルチモーダル情報の統合的処理に加え、国や風習、言語など社会的・文化的文脈の多様性を理解し、それに応じて対話スタイルを柔軟に適応させることが重要です。さらに、会話分析・言語学・心理学といった、対話の本質を探究する学問領域の知見を取り入れることが、より人間らしいAIの発展を促すでしょう。

対話ロボット「Pepper」についてはこちら:

https://www.softbankrobotics.com/jp/product/pepper/home/

OpenAIの「リアルタイムAPI」についてはこちら:

https://platform.openai.com/docs/guides/realtime

Transformer構造の自己注意機構(Self-Attention)についてはこちら:

https://arxiv.org/abs/1706.03762

あわせて読みたい: