- 目次

1.AI活用のリスクと向き合う。企業に必要な「認識の転換」

業務効率の向上、生産性の改善、人材不足への対応など、今やAIなしには企業活動そのものが成立しない状況になりつつあります。生成AIの急速な普及はビジネスのあり方を大きく変えましたが、その裏側でリスクも確実に拡大しています。

NTTデータ セキュリティ&ネットワーク事業部長の鴨田浩明は、世の中のAIの普及や活用の様子を交えてこう語ります。

「AIは、業務だけではなく日常生活も含め、幅広い世代に急速に浸透しつつあります。目的に応じた多様な使い方が生まれ、こうしたプラットフォームがここまで社会に受け入れられるのは、久しぶりのことだと感じています。一方で、使い方のバリエーションが増えるということは、悪用されるリスクもそれだけ高くなる。そうした事態を想定し、対策が不可欠だと考えています」(鴨田)

AI技術の進化は従来のAIから生成AI、そしてAgentic AI、さらにはPhysical AIへと広がり続けています。企業がAIを業務で活用するためには、AI活用を推進するだけでなく、AIを安全にコントロールする対策の両方が必要です。

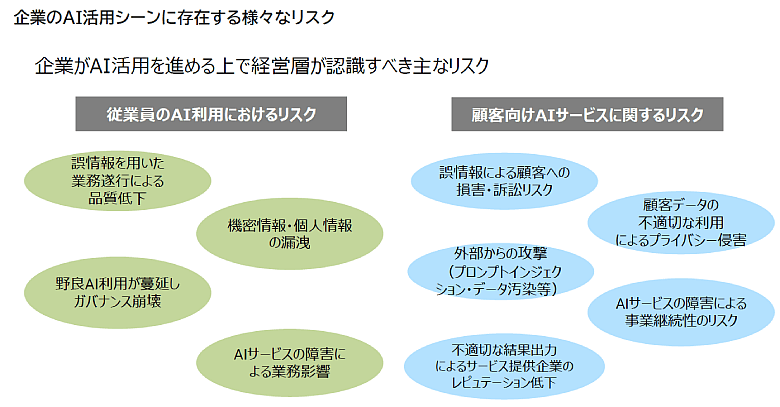

実際に企業がAIを活用する上では、多岐にわたるリスクが存在します。従業員が社内でAIを利用するケースでは、AIが出力する誤情報をそのまま業務に使ってしまうことによる品質低下のリスク。機密情報や個人情報をAIに入力してしまうことによる漏えいリスク。そして会社が認めていないAIサービスを勝手に利用することでガバナンスが崩壊する危険性があります。

顧客向けのAIサービスに関しても、外部からのプロンプトインジェクション攻撃やデータ汚染、AIの不適切な出力によるレピュテーション低下など、経営に直結するリスクが潜んでいます。

図1:企業のAI活用シーンに存在するリスク

「過去のテクノロジーの歴史を見ても大抵の場合、セキュリティは後回しになりがちです。新しい技術が出ると、まず使ってみて広めてみて、大きなインシデントが起きてから慌ててセキュリティに取り組む。その歴史を繰り返してきました。ただ、生成AIに関しては導入前からセキュリティも考えなければという意識が、経営者の間で広がりつつある。これは前向きな変化だと感じています」(鴨田)

攻撃者がAIを使いこなす一方で、企業も業務を遂行する場面にAIが組み込まれ始めています。AIは、一部の先進企業の技術ではなく、企業活動の一部になりつつあります。AI活用とセキュリティは、どちらか一方を選ぶ問題ではありません。むしろ、AIを活用しないことのほうがリスクになる時代において、重要なのは「使いながら守る」ための仕組みを整えることなのです。

2.AI活用を安全に推進する体制づくり──NTTデータの自社実践

AIは、「攻撃」にも「業務」にも活用される存在となりました。では、「使いながら守る」体制をどのように構築すればよいのでしょうか。鴨田が示したのは、NTT DATA自身の実践です。

NTT DATAは、AIリスク管理を専任で担う「AIガバナンス室」を設置し、グループ各社のAIリスク関連部門と連携してグローバルなAIガバナンス体制を構築しています。技術・法務・倫理・消費者視点など複数の領域の外部有識者が参画するアドバイザリーボードも設けています。グローバル共通のAIリスクマネジメントポリシーを策定し、国内事業会社を対象とした社内規定や生成AI利用ガイドラインを整備。個別のAIプロジェクトに対するリスク評価と対応も実施しています。

とりわけ注目すべきは、世界70ヵ国以上、約20万人の社員を対象にAIガードレールの導入と運用を段階的に開始しているという点です。野良AI対策としては、SASEの代表的ソリューションであるZscaler(ゼットスケーラー)を活用して、AIサービスへのアクセスをプロジェクト単位で制御し、さらにファイルのアップロードそのものにも規制をかけるという二段構えの対策を敷いています。ブラックリスト方式による未許可AIサービスへのアクセス遮断に加え、許可されたサービスであっても機密情報の流出を防ぐ仕組みを重層的に整備しているのです。

「ガバナンスとは、利用を抑止するためのものではありません。社員がAIを安心して使うために必要な基盤です。しっかりしたガバナンスがあるからこそ、活用が広がる。抑制ではなく、促進のための仕組みなのです」(鴨田)

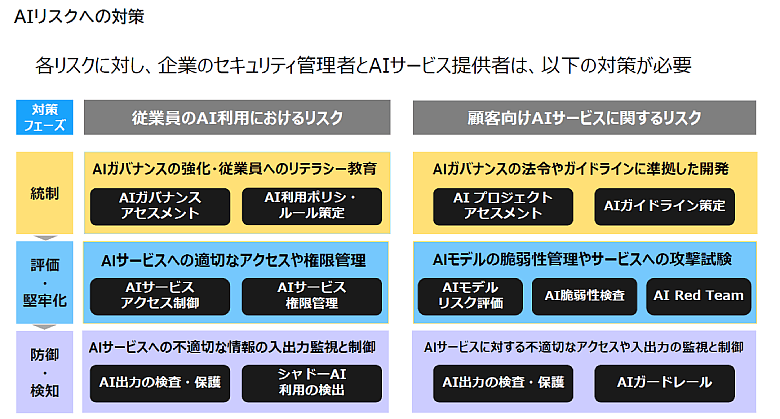

図2:AIリスクへの対策

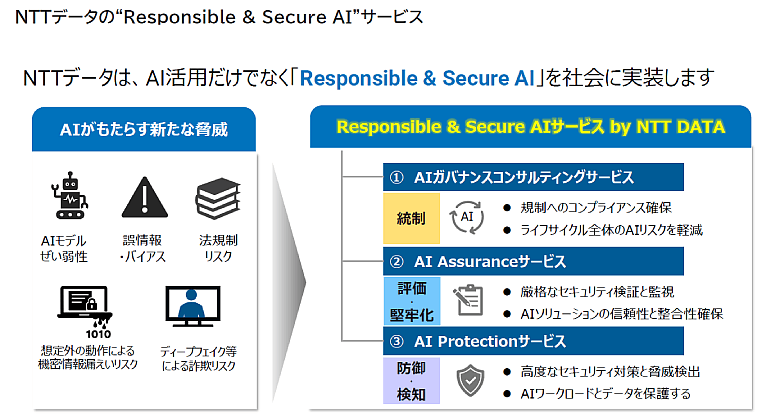

そしてNTT DATAは、この自社実践の知見を体系化し、「Responsible & Secure AI」というフレームワークとして顧客向けにサービス化しています。このフレームワークは「AIガバナンス」「AIアシュアランス」「AIプロテクション」の3層で構成され、企業のAI活用を統制・評価・防御の各観点から一気通貫で支えるものです。

3.「Responsible & Secure AI」──止めずに守るという発想の転換

Responsible & Secure AIサービスの3層は、それぞれ明確な役割を持っています。

図3:自社実践の知見を体系化した「Responsible & Secure AI」

第1層の「AIガバナンスコンサルティングサービス」は「統制」を担います。AIプロジェクトと会社・組織・人の両面において、リスクの検知・評価を実施。AIガバナンスアセスメントやAIプロジェクトアセスメントを通じてリスクを可視化し、ガイドライン策定、AIリスクマネジメントポリシーの構築、組織整備、教育コンテンツの提供まで包括的に支援します。

第2層の「AI Assuranceサービス」は「評価・堅牢化」を担当します。導入するAIモデル単体の応答特性の比較評価から、AIを含むシステム全体の安全性評価や脆弱(ぜいじゃく)性診断、そしてAI Red Teamによる実践的な攻撃試験まで、厳格なセキュリティ検証を実施します。さらに、AIガードレールをどのように設計すべきかという観点から、保護機能の設定の違いによる比較評価も行います。いわば「AIを動かす前に確かめる」ためのサービスです。

第3層の「AI Protectionサービス」は「防御・検知」のフェーズです。AIガードレールを用いて、AIに対する入力と出力をリアルタイムで監視します。倫理的・法的に不適切なAI応答や有害情報から社員のAI利用を保護する機能と、プロンプトインジェクションやデータ漏えいを引き起こす悪意ある攻撃からAIシステム自体を保護する機能を備え、「使うことを前提に守る」仕組みを実現します。

鴨田はこの第3層の意義をこう強調します。

「完璧はありません。だからこそ最後のとりでとして、AIの入出力をリアルタイムでチェックする。何かあればAIの学習を再構築したり、ガードレールのルールをアップデートしたりして、なるべくAIの利用を止めないように守っていく。この“止めずに守る”発想こそが、AI時代のセキュリティにおける最も重要な転換点だと考えています」(鴨田)

NTT DATAの差別化のポイントは、自社を「クライアントゼロ」(※)として大規模環境でAIガードレールを運用してきた実績にあります。世の中にはAIセキュリティ関連のベンチャーソリューションが数百も存在していますが、どれも単独では完璧ではなく、顧客の要件に合わせた組み合わせとカスタマイズが求められます。NTT DATAは自社での実運用を通じて、検証済みの組み合わせとマネージドノウハウを蓄積し、それを顧客に提供できる立場にあるのです。

さらに、NTTグループのインフラとの連携も大きな強みです。データセンターやGPU as a Serviceに加え、IOWNの光ネットワークによるセキュアなAI間接続、国産LLM「tsuzumi」によるオンプレミスでの超セキュアな運用など、インフラからサービスまでを包括的に提供できる体制を整えています。

お客さまへのサービス提供前に、当社自身を最初の顧客(クライアント)と想定し、大規模に社内へ新技術を導入・運用することで、ノウハウを蓄積するプロセスのこと

4.AI活用の時代を、恐れず、責任を持って進むために

前編で見てきたように、サイバー攻撃はAIの進化とともに高度化し、もはや常態化しています。一方で、企業にとってAI活用は選択肢ではなく必須の経営課題です。

だからこそ、AI活用とセキュリティを両立させるための仕組みが必要です。求められているのは、AI活用を恐れることではなく、どう安全に、責任を持って前に進めるかという視点。ガバナンス、アシュアランス、プロテクションの3層を一気通貫で整備していくことが、これからの時代には不可欠になるでしょう。

鴨田は最後にこう語ります。

「企業単独でAIセキュリティのすべてに対応するのは、率直に言って難しい時代です。だからこそ、伴走するパートナーの存在が価値を持つ。NTT DATAは、お客さまがAIによる価値創出を実現するために、安全で持続可能なイノベーションを通じて貢献していきます」(鴨田)

AIとセキュリティの両立。その実践のかたちを、NTT DATAは自らの挑戦を通じて社会に示し続けています。

サイバーセキュリティについてはこちら:

https://www.nttdata.com/jp/ja/services/security/

生成AI(Generative AI)についてはこちら:

https://www.nttdata.com/jp/ja/services/generative-ai/

あわせて読みたい: