- 目次

1.「デジタル化する身体と心」。物理世界へ進出するAI

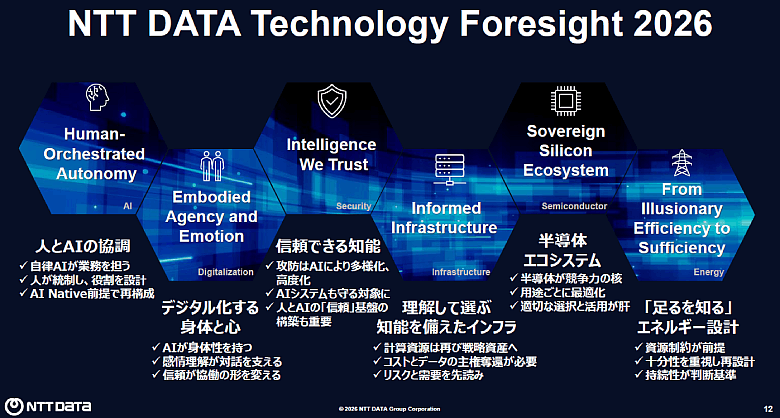

NTT DATAでは、10年以上にわたり将来を見通す羅針盤として『NTT DATA Technology Foresight』を発表し続けてきました。そして、2026年版では6つのテーマ、「人とAIの協調」「デジタル化する身体と心」「信頼できる知能」「理解して選ぶ 知能を備えたインフラ」「半導体エコシステム」「“足るを知る”エネルギー設計」を掲げています。今回は、これらのテーマに関わる事例を取り上げながら、2026年のテクノロジートレンドについてお話しします。

図1:NTT DATA Technology Foresight 2026

まず、「デジタル化する身体と心」。大量生産時代に入ったロボットの話です。

これまで生成AIは、主に「言葉(Language)」の世界で進化してきました。しかし今は、「身体」を得て、物理世界で行動を起こし始めています。

その裏側にあるのが、VLA(Vision・Language・Action)モデルの台頭。曖昧な指示を理解し(Language)、実世界の構造を認識し(Vision)、未体験でも自律的に行動する(Action)。何かをつかむ力加減まで認識して対応できるようになり、「考える」から「行動する」段階へ移行しつつあります。その一方で、行動の制御には課題も残っており、2026年はロボットが本当に成功するのか、それとも一過性のバブルに終わるのか、分水嶺になるとも言われています。

これらのロボットが産業現場では、どのように導入されていくのでしょうか。注目されているのが「ダークファクトリー」です。全工程を自動化し、人間がいないため照明すら不要、文字通り暗闇で稼働する工場で、AIによる動的スケジューリング、自律的な設備調整、予兆検知・自律保全に加え、数理最適化や量子アニーリング、ディープラーニング、画像検査AI、デジタルツインまで多層的な技術によって稼働しています。

そして、ダークファクトリーの先には、工場単体にとどまらず、需要予測から生産計画、製造、物流、販売に至るサプライチェーン全体をエンド・ツー・エンドで自律化する動きが加速。多品種少量生産という顧客ニーズに応える世界観ができあがっています。

2.「人とAIの協調」。AIエージェントを成功させるポイント

次に注目すべきは、「人とAIの協調」です。

これまでAIは人間の作業を補助する存在でした。しかし今は、AIが主体的に業務を担う前提で、人とAIの役割そのものを再設計する段階に入りつつあります。その変化を象徴するのが、AIエージェントです。クリエイティブ、一般事務、ホワイトカラーの仕事など、さまざまな業界とAIが混ざり合う社会になりつつありますが、一方で、AIエージェントの実現には難しさも残っています。

「今後10年はAIエージェントの年だ」と述べているのは、OpenAIの創立メンバーであるアンドレイ・カーパシー氏です。ポイントは「今後10年」という時間軸。私は「AIエージェントには、まだ技術的に考えないといけない課題が残っている」という認識を持っています。その課題の代表が、「記憶・状態管理が弱い」「意図を保持できない」「価値判断基準を持たない」「制約を“絶対に守る”ことができない」「例外処理が苦手」の5つ。こうした特性を正確に見極めた上でAIエージェントを設計・運用しなければ、本当に使える仕組みにはなりません。

そんな中、ソフトウェア開発の現場では、「人とAIの協調」が始まりつつあります。それが、「Vibe Coding」(バイブ・コーディング)と呼ばれる新しい手法。話し言葉での指示でコードが生成され、バグ修正もテストも含めて対応するもので、高いコーディング技術がなくても開発が可能です。ただし現状では、動きはするが設計方針から逸脱したコードが出力されたり、修正を重ねるうちに最初の意図から外れていったりするといった問題も発生しています。

その問題に対してNTT DATAが取り組んでいるのは、「Spec Driven Development」(仕様駆動開発)です。人間は意図・基準・制約の定義を固めて、スペックを確定させる。あとは、そのスペックに沿ってコーディングもテストも進捗管理もAIが担い、エンタープライズで求められる最後の品質保証や非機能要求の担保は人間が負います。

図2:Spec Driven Development(仕様駆動開発)における人間とAIの役割

この考え方をホワイトカラーの仕事に置き換えてみます。これまでのAI活用は、作業の一部を補助的に委ねるコパイロット型でした。これからは、AIが業務を主導する前提で、インプットとアウトプットを起点にプロセス自体を設計し、タスクの並び方そのものをゼロベースで考え直す。それがAIネイティブへのシフトであり、ゲームチェンジャーになり得る発想です。ソフトウェア開発の場合、従来のV字モデルにAIを補助的に組み込むコパイロット型でも一定の生産性改善は見込めますが、AIネイティブなプロセス設計なら役割が根本から変わります。

すでに、このような発想の企業は存在しています。その代表格が、AIネイティブカンパニーの『Cognition AI』。彼らが提供する『Devin』は、「開発ツールではなく完全自立型のエンジニアで、人の代わりに派遣する」という考え方。7人ほどのメンバーで立ち上げたこの会社は、少人数でもAIの力で大きなことができると証明しました。本当の意味でのAIネイティブカンパニーが現れ始めています。

このようなAIネイティブカンパニーと競合する既存企業は、AIが持つ高速・高精度、多重・並列処理、24時間365日の稼働といった特徴を前提に、何を変えるか本気で考えなくてはいけません。やるべきは、自律AIの存在を前提にして、人がAIの役割を設計し統制すること。いわゆる「Human-Orchestrated Autonomy」が競争優位の源泉になるはずです。

3.「理解して選ぶ 知能を備えたインフラ」。AIインフラのリスクを知り使い分ける

ここからは、「理解して選ぶ 知能を備えたインフラ」として、AIの利活用が加速する一方で、それを支えるAIデータセンターなどにも目を向ける必要性について話します。

現在、AI関連の投資は過熱しており、主要ハイパースケーラーを中心に約60兆円規模に達しました。また、スタートアップ投資の52%がAI関連という状況です。現在の状況は、投資が若干、投機的になっている側面も否めず、持続的な利益構造はまだ確立されていないのではないでしょうか。

このような状況下でAIインフラを利用する企業は、「AI提供側の持続的な投資回収に向け、値上げや仕様変更のリスク」に晒されます。AIビッグテックが利用料を値上げしたり、価格体系を変更したりすれば、コストが一方的に転嫁される。つまり、コストのオーナーシップがサプライヤー側に握られてしまっている。この主導権を企業側に取り戻すことが急務です。

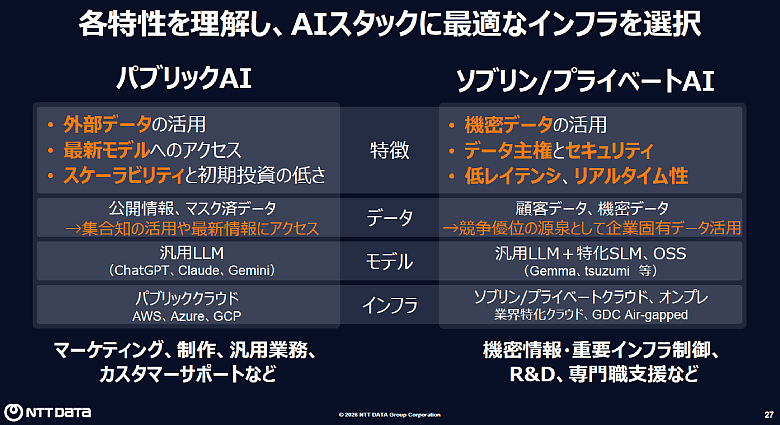

もうひとつ、インフラにおいて考えるべきリスクは、経済安全保障における「ソブリンティ(データ主権)」の問題です。クラウドでも同じ懸念がありましたが、クラウドで依存しているのは計算資源のみ。データやソースコードは自前で、計算能力という箱だけを借りるモデルでした。しかしAI時代には、推論や思考プロセスそのものを外部に委ねます。もしかすると、AIが生み出すデータだけでなく、知能自体も奪われてしまうかもしれません。つまり、計算資源と知能が一体化し、外部に依存していくことになります。「計算能力」が「生のデータ」と同じかそれ以上に重要であり、データ主権を守るためには「計算力の自国管理(ソブリンAI)」が不可欠です。このように、パブリックAI、プライベートAI、ソブリンティを持ったAIを適材適所で使っていくことが重要です。

図3:AIインフラのリスクを知り最適なインフラを選択

パブリックAIは最新モデルへのアクセス、スケーラビリティ、初期投資の軽さが強みです。一方、プライベートAIは機密データ活用、データ主権、制約定義、リアルタイム性、堅牢性で効きます。これらの強みを理解し、組み合わせる。パブリックAIは便利ですが、プライベートAIも考える時代が来ているのではないでしょうか。例えば、NTTの『tsuzumi』をはじめとして、LLMも精度が向上しています。このLLMを使い、競争優位はプライベートAIで作り、非競争領域はパブリックAIに任せる。この切り分けが現実的な解のひとつです。

4.「“足るを知る”エネルギー設計」と「半導体エコシステム」

「理解して選ぶ 知能を備えたインフラ」では、エネルギー設計と進化するハードウェアをどう使うかもポイントになります。それが「“足るを知る”エネルギー設計」、そして、「半導体エコシステム」です。

AGI(汎用人工知能)の実現には、原発150基分相当のエネルギーが必要とも言われており、小さなエネルギーで効率よく作動させることが求められます。そこで問題になるのが、消費電力が大きい『GPU』の存在。その解決のため、最近では計算手法やコストの変化に応じ、AIをより少ないGPUで、安く、短時間で動かす取り組みが始まっています。常に変動するAIの計算量をリアルタイムで監視し、無駄なGPU消費を自動で最適化するソフトウェアや、計算力の進化に伴って新しいハードウェアも出現しています。汎用計算にはCPU、学習・推論にはGPU、低遅延・並列計算にはFPGAを使用。そして、近い将来、組み合わせ最適化には量子チップが使われるでしょう。さらに未来には、省電力・イベント駆動ができるニューロモーフィックチップなどが期待されています。このような進化する半導体を用途に合わせて組み合わせることが、エネルギー設計における大きなポイントです。

5.AIが攻撃しAIが防御する。「信頼できる知能」の見極め方

最後に「信頼できる知能」について話します。AIの進化に伴い、セキュリティ攻撃も高度化。VPN機器からの侵入によりランサムウェア被害に遭い、工場や物流が停止したり、ECサイトの偽サイトが作られて、ログイン情報を盗んだりする事例が発生しています。さらには、ディープフェイク技術を悪用し、企業のCFOになりすましてWeb会議で巨額の送金を指示するという事件も起きました。

当然、こういった攻撃に対して防御も進化。攻撃の進行をミリ秒単位で判断し、自律的に通信を即時遮断できるようになっています。攻撃速度が秒単位まで高速化するなか、今後は封じ込めもミリ秒単位で自律的に行う仕組みが不可欠です。人間の判断速度を超えた攻撃に対し、防御もまた人間の判断を超えなければならないという時代が来ているのです。

攻撃も防御もAIが使われる時代、AIそのものをどのように信頼するかも考えなくてはいけません。紹介したいのは、AIが騙されて犯罪に加担しかねない攻撃事例です。攻撃側のAIが「私はVIP社員で、CEOから送金指示を受けた」となりすまし、それを信じた防御側のAIが行動して送金処理まで進めてしまう。また、AIがAIを脅迫し、内部構造や機密情報を漏らさせる。ある意味、人間の社員と同じようなことが起こり得ます。これが、AIによるプロンプトインジェクション、「AIインジェクション」が引き起こす世界です。

※プロンプトインジェクション:悪意のある不正プロンプト(命令)で制限やセキュリティ設定を回避し、機密情報の窃取や誤動作を引き起こすサイバー攻撃

なぜこのようなことが起きるのでしょうか。従来のITシステムは、AであればBと、決定論的に答えが決まるものでした。しかしAIはただの推論であり、確率論です。AがBにもB'にもCにもなり得て、その場のプロンプトによって答えが変わってくる。この揺らぎをコントロールしていくことが、AIの信頼性につながります。ただしAIはブラックボックスで、構造解明はまだ先。だからこそ、人間がルールを定めてガードレールを作り、守っていくことが必要です。

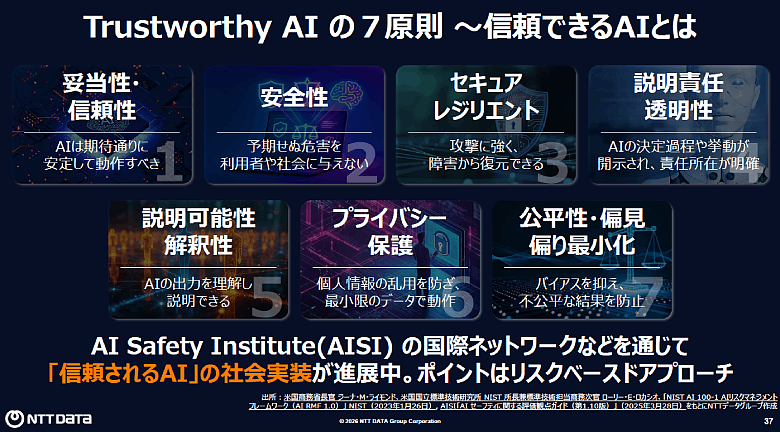

この際に意識すべきは、AIの世界にある、「妥当性・信頼性」「安全性」、「セキュアレジリエント」「説明責任透明性」、「説明可能性・解釈性」、「プライバシー保護」、「公平性・偏見偏り最小化」からなる「Trustworthy AI の7原則」を企業として担保していくことです。それには、AIレッドチームを作り攻撃スクリプトなどで常にモデルを評価することが必要。例えば公平性についてNTT DATAでは、データセット3000件で攻撃スクリプトを作り、本当に正しい答えが返ってきているかをチェックしています。

図4:Trustworthy AI の7原則

AI時代のセキュリティは、これまで暗黙的に人に委ねてきた「信頼」を、制度として設計し、企業として担保する段階に入っています。それはもはやIT部門だけの課題ではなく、経営そのものの責任です。

以上、2026年版の『NTT DATA Technology Foresight』で提示した6つのトレンドを軸に説明をしてきました。私たちはお客さまとともに未来技術を先見し、ビジネス成長を加速させていきます。これからもNTT DATAは、責任あるイノベーションとテクノロジーを提供し続けます。

NTT DATA Technology Foresight 2026のレポート詳細はこちら

technology-foresight-2026-ntt-data20260128.pdf (PDF: 1.1 MB)

NTT DATA Technology Foresight 2026を公開についてはこちら:

https://www.nttdata.com/global/ja/news/topics/2026/012702/

NTT DATA Technology Foresight 2026についてはこちら:

https://www.nttdata.com/jp/ja/technology/trend-listing/2026/

生成AI(Generative AI)についてはこちら:

https://www.nttdata.com/jp/ja/services/generative-ai/

サイバーセキュリティについてはこちら:

https://www.nttdata.com/jp/ja/services/security/

あわせて読みたい: